贝壳找房流量分发数据回收与治理的演进之路 构建高效、可靠的数据处理服务

在当今数据驱动的房地产交易服务领域,贝壳找房作为领先的平台,其流量分发系统的效率与精准度直接影响用户体验与平台价值。而支撑这一系统的核心,是一套持续演进、不断优化的数据回收与治理体系及其背后的数据处理服务。本文将深入探讨贝壳在此领域的演进路径与实践经验。

一、 初期:数据采集与基础回收的构建

贝壳的旅程始于对流量数据的全面感知。早期,面对APP、PC网站、小程序等多渠道的海量用户访问、搜索、点击、浏览、咨询等行为数据,首要任务是建立统一、实时、完整的数据采集与回收管道。这一阶段,团队聚焦于:

- 埋点标准化:制定统一的数据埋点规范,确保各业务线、各终端上报的数据格式、字段定义一致,为后续处理打下基础。

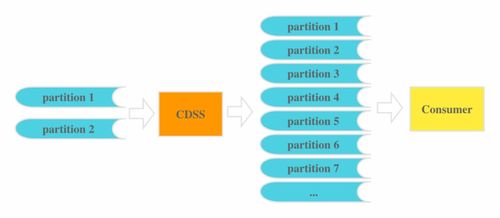

- 管道建设:搭建高吞吐、低延迟的数据流处理管道(如基于Kafka、Flink的实时流),确保用户行为数据能够被及时、完整地收集到数据湖或数据仓库中。

- 基础治理:建立初步的数据质量监控,关注数据上报的延迟、丢失率、格式错误等基础问题,保障数据“收得回来”。

此阶段的数据处理服务相对分散,主要服务于简单的业务报表和流量看板,数据价值挖掘尚处浅层。

二、 发展期:治理深化与价值提炼

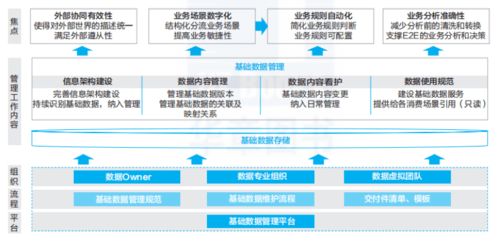

随着数据量激增和业务复杂化,粗放的数据管理难以为继。贝壳进入了以“治理”为核心的演进阶段,目标是将原始数据转化为高质量、可信赖的数据资产。

- 元数据与数据血缘管理:建立统一的元数据中心,清晰定义每一份流量数据的业务含义、来源、加工过程与下游依赖。数据血缘追踪让数据的来龙去脉一目了然,极大地提升了问题定位与影响分析的效率。

- 数据质量体系化:从完整性、准确性、一致性、及时性、唯一性等多个维度构建数据质量规则库。通过自动化的质量监控、告警和工单系统,实现数据质量问题的主动发现与闭环处理,确保用于流量分析和模型训练的数据是可靠的。

- 主题域数据模型建设:针对流量分发场景,构建如“用户行为事件”、“房源曝光”、“商机转化”等主题域模型。通过维度建模等方式,将原始日志清洗、整合成易于理解和分析的数据集,显著提升了数据分析师和算法工程师的效率。

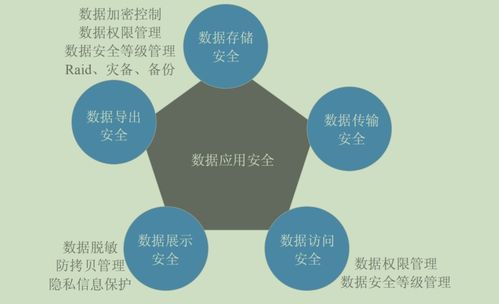

- 隐私与安全合规:在数据回收与处理的全链路中,嵌入数据脱敏、访问权限控制、合规审计等机制,严格保护用户隐私,满足日益严格的监管要求。

此阶段的数据处理服务开始平台化,提供了数据开发、任务调度、质量监控等一站式能力。

三、 成熟期:智能化、服务化与业务赋能

当前,贝壳的数据处理服务已演进为支撑流量分发智能化决策的核心基础设施。其特征是高度的自动化、智能化和业务闭环。

- 智能数据治理:引入机器学习技术,实现数据质量的智能根因分析、异常模式自动检测、数据标准智能推荐等,将治理人员从繁琐的规则配置与排查中解放出来。

- 实时数据服务(Data Serving):数据处理的结果不再仅存于离线数仓。通过构建低延迟的实时数仓和在线查询服务,将处理好的用户画像、实时行为序列、房源热度等数据,以API或特征的形式,毫秒级地提供给线上的推荐、搜索、排序等流量分发引擎,驱动实时个性化。

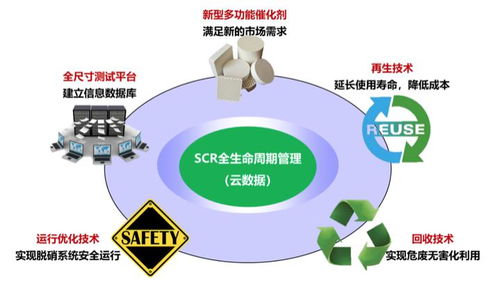

- 全链路可观测与反馈闭环:建立从流量分发决策(如某个房源是否曝光、排序位置)到用户后续行为(如点击、带看、成交)的全链路数据追踪与归因分析体系。数据处理服务不仅回收“因”的数据(用户请求),也紧密关联“果”的数据(转化结果),形成“数据回收 -> 模型训练/策略优化 -> 线上分发 -> 效果回收 -> 再优化”的完整数据驱动闭环。

- 统一数据产品与自助平台:为产品、运营、算法等不同角色提供可视化的数据产品(如流量分析平台、AB实验平台、用户洞察平台)和自助分析工具,降低数据使用门槛,让数据能力深度赋能业务决策。

持续演进,驱动增长

贝壳找房流量分发数据回收与治理的演进之路,是一条从“有数据”到“用好数据”的路径。它不仅是技术的升级,更是组织数据文化与协同方式的变革。通过构建并持续优化这套高效、可靠、智能的数据处理服务体系,贝壳确保了其流量分发的精准与高效,最终实现了提升用户体验、促进平台生态繁荣的核心目标。随着技术的进步和业务的发展,这一演进之路仍将延续,向着更实时、更智能、更深度融合业务的方向不断探索。

如若转载,请注明出处:http://www.easicomedia.com/product/19.html

更新时间:2026-04-15 04:28:32